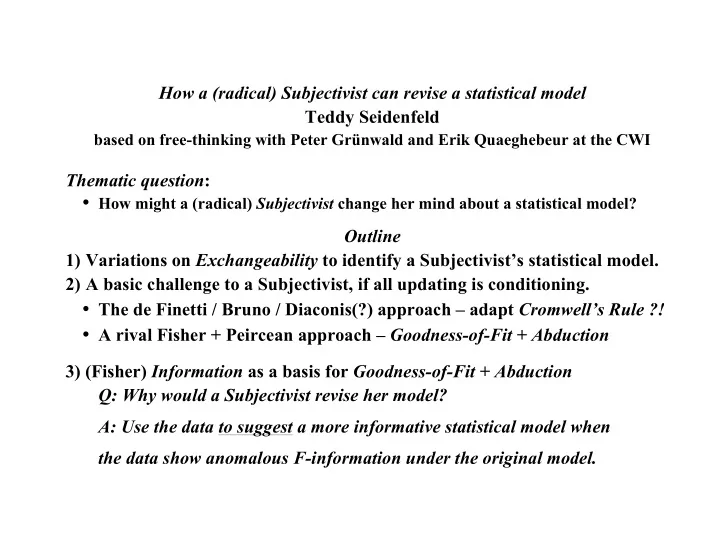

SLIDE 1 How a (radical) Subjectivist can revise a statistical model Teddy Seidenfeld

based on free-thinking with Peter Grünwald and Erik Quaeghebeur at the CWI

Thematic question:

- How might a (radical) Subjectivist change her mind about a statistical model?

Outline 1) Variations on Exchangeability to identify a Subjectivist’s statistical model. 2) A basic challenge to a Subjectivist, if all updating is conditioning.

- The de Finetti / Bruno / Diaconis(?) approach – adapt Cromwell’s Rule ?!

- A rival Fisher + Peircean approach – Goodness-of-Fit + Abduction

3) (Fisher) Information as a basis for Goodness-of-Fit + Abduction Q: Why would a Subjectivist revise her model? A: Use the data to suggest a more informative statistical model when the data show anomalous F-information under the original model.

SLIDE 2 1) Variations on Exchangeability to specify a Subjectivist’s statistical model. For a (radical) Subjectivist, e.g. de Finetti, there is only personal probability. He famously writes, My thesis, paradoxically, and a little provocatively, but nonetheless genuinely, is simply this: PROBABILITY DOES NOT EXIST. de Finetti (1974, preface) For such a Subjectivist, a candidate for an (objective) statistical model is via Exchangeability.

- Here “objectivity” means “inter-personal agreement” !

SLIDE 3 Continuing Example: The Subjectivist considers a denumerable sequence of realizations of binary random variables Xn, each with sample space {0, 1}. The Subjectivist imagines a sequence <X1 = u1, X2 = u2, …, Xn = un , … > with < u1, u2, …, un , … > a sequence of 0’s and 1’s, and she adopts for her joint distribution the symmetries of exchangeability.

- For each n, her distribution for <X1, …, Xn> is permutation invariant.

And we have the celebrated result of de Finetti. Exchangeability holds if and only if The joint distribution can be written as a mixture of iid Bernoulli trials.

SLIDE 4 Specifically: Let s = u1 + … + un and let θ be a r.v. supported by [0, 1] with (marginal) distribution P(Θ). Exchangeability obtains just in case P[X1 = u1, X2 = u2, …, Xn = un | θ] = θs(1-θ)n-s – a conditional iid stat. model and P[X1 = u1, X2 = u2, …, Xn = un] = EP(Θ)[θs(1-θ)n-s] and P(Θ) is fully determined by the Subjectivist’s personal probability

- ver the imagined denumerable sequence of binary trials.

- The

iid Bernoulli statistical model for these hypothetical data is shared among any set of Subjectivists each of whom adopts Exchangeability for his personal probability over this denumerable sequence of binary trials.

- Objectivity of the statistical model, for these Subjectivists, means

interpersonal agreement on Exchangeability.

SLIDE 5 Now, suppose the sequence is for a binary outcome of a new drug to be tested

- n human subjects in a clinical trial. The investigator adopts an Exchangeable

“prior” opinion. The experiment proceeds and the initial 20 observed

- utcomes are <0,1,1,0,1,0,1,0,0,1,1,0,1,0,0,1,1,0,1,0> with s20 = 10.

Suppose that the gender is also observed, so that the observed data are <0,1,1,0,1,0,1,0,0,1,1,0,1,0,0,1,1,0,1,0> with s10 = 7 and s10 = 3. What might our Subjectivist do to rethink her statistical model and change, perhaps, to a partial exchangeable one: Exchangeability given gender

SLIDE 6

Specifically: Let (sM, sF) = (uM

1 + … + uM n1 , uF 1 + … + uF n2)

and let (θM, θF) be supported by [0, 1]2 with joint distribution P(Θ). Partial Exchangeability obtains just in case

P[XM

1 = uM 1 XM 2 = uM 2 … XM n1 = uM n1 , XF 1 = uF 1 XF 2 = uF 2 … XF n2 = uM n2 | (θM,θF) ]

= θM

sM(1-θM)n1- sM × θF sF(1-θF)n2- sF – a conditional iid bivariate model

and

P[XM

1 = uM 1 XM 2 = uM 2 … XM n1 = uM n1 , XF 1 = uF 1 XF 2 = uF 2 … XF n2 = uM n2 ]

= EP(Θ)[θM

sM(1-θM)n1- sM × θF sF(1-θF)n2- sF]

SLIDE 7 How does our Subjectivist explore whether or not to adopt an Exchangeable model – gender doesn’t matter

- r a Partial Exchangeable model – where gender might matter?

- de Finetti / Bruno / Diaconis approach the problem by advising our

Subjectivist to use a Partial Exchangeable model with prior support on all of Θ = [0, 1]2 but with sufficient prior mass concentrated along the main diagonal (θM = θF). (Cromwell’s Rule) Then, let Bayes conditioning work its magic to create her posterior. If gender doesn’t matter, almost surely the posterior will concentrate along the main diagonal. If gender does matter, almost surely the posterior will concentrate elsewhere in Θ = [0, 1]2.

SLIDE 8

There are (at least) two concerns I have with this advice for how a Subjectivist might examine her statistical model. 1) In advance of seeing the data, which subpopulations (which factors) does she consider in building her Partial Exchangeable model? In addition to the subject’s gender, what of age, number of siblings, favorite music, …? The de Finetti (1959) / Bruno (1964) / Diaconis (1988) approach works with finitely many such factors.

SLIDE 9 2) Even if the Partial Exchangeable model concentrates its posterior along the main diagonal, so that gender does not matter, it may still be the case that the original sequence is not exchangeable. That the posterior concentrates at the main diagonal is not a sufficient condition that the

- verall process is exchangeable.

<0, 1, 1, 1, 0, 0, 0, 0, 1, 1, 1, 0, 1, 0, 0, 1, 0, 1, 0, 1> with s10 = 5 = s10. The sequence is suspiciously non-exchangeable as there is perfect (negative) correlation in the gender-couples.

Exercise: Find other interesting patterns relating to 20-exchangeable.

- What higher-order constraints may be used to define sub-populations?

SLIDE 10 Return, first, to some old non-Bayesian themes in model selection. R.A.Fisher (1890 – 1962)

- Fisher’s (1928) Goodness-of-Fit tests as Fisherian significance testing.

H is a statistical hypothesis. Data d are observed and are rare under H. Therefore, either H is false or something rare has occurred.

SLIDE 11

Goodness-of-fit as significance testing – role of F-Information in the test. Heuristic Example: Independence in a 2 × 2 Table.

Consider ¡conditional ¡iid ¡data ¡from ¡flips ¡of ¡two ¡coins, ¡summarized ¡in ¡the ¡table ¡below, ¡where ¡ we ¡are ¡concerned ¡about ¡the ¡composite ¡hypothesis ¡H ¡that ¡the ¡coins ¡have ¡a ¡common ¡bias, ¡e.g., ¡ that ¡the ¡sequence ¡is ¡exchangeable, ¡not ¡merely ¡partially ¡exchangeable. ¡

¡ ¡2 ¡× ¡2 ¡TABLE ¡ ¡ ¡ heads ¡ tails ¡ ¡ coin-‑1 ¡ ¡ ¡a ¡ b ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ a+b ¡= ¡n1 ¡flips ¡ ¡ coin-‑2 ¡ ¡ ¡c ¡ d ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ c+d ¡= ¡n2 ¡flips ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡a+c ¡heads ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡b+d ¡tails ¡ ¡ ¡ ¡ ¡ ¡ n1+n2 ¡= ¡N ¡flips ¡total. ¡ ¡ Let ¡θ0 ¡be ¡an ¡hypothesized ¡value ¡for ¡the ¡common ¡bias ¡of ¡the ¡two ¡coins. ¡ ¡The ¡𝜓!

!test ¡for ¡

independence ¡(with ¡2-‑degrees ¡of ¡freedom) ¡is ¡just ¡the ¡sum ¡of ¡the ¡two, ¡separate ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ 1-‑degree ¡of ¡freedom ¡χ2-‑tests ¡for ¡the ¡two ¡samples ¡(of ¡sizes ¡n1 ¡and ¡n2, ¡respectively): ¡ 𝜓!

! ¡= ¡(a-‑θ0n1)2/θ0n1 ¡ ¡+ ¡(b-‑[1-‑θ0]n1)2/[1-‑θ0]n1 ¡+ ¡(c-‑θ0n2)2/θ0n2 ¡+ ¡(d-‑[1-‑θ0]n2)2/[1-‑θ0]n2. ¡

¡

SLIDE 12

As ¡you ¡recall, ¡Fisher’s ¡controversial ¡proposal ¡for ¡the ¡χ2-‑independence ¡test ¡of ¡the ¡ ¡ composite ¡hypothesis ¡H ¡is ¡to ¡substitute ¡the ¡m.l.e ¡under ¡the ¡“null” ¡hypothesis ¡H, ¡to ¡ replace ¡the ¡unknown ¡θ0 ¡with ¡the ¡quantity ¡(a+c)/N, ¡resulting ¡in ¡a ¡χ2 ¡test ¡with ¡1 ¡ degree ¡of ¡freedom. ¡ ¡ ¡ ¡ The ¡familiar ¡story ¡is ¡that ¡this ¡provides ¡an ¡approximation ¡to ¡the ¡ ¡ Exact ¡Fisher ¡Test ¡which ¡is ¡obtained ¡by ¡assuming ¡that ¡– ¡under ¡composite ¡H, ¡ ¡ ¡ ¡ the ¡4 ¡marginal ¡totals ¡are ¡ancillary ¡for ¡the ¡unknown ¡θ0. ¡ ¡ There ¡is ¡a ¡different ¡answer ¡based ¡on ¡the ¡connection ¡between ¡this ¡use ¡of ¡the ¡m.l.e. ¡ in ¡the ¡χ2 ¡test ¡and ¡the ¡importance ¡that ¡estimates ¡conserve ¡F-‑Information. ¡

¡

¡

SLIDE 13

Significance ¡tests ¡are ¡rudimentary ¡in ¡their ¡conclusion ¡– ¡ ¡ “Either ¡a ¡rare ¡event ¡has ¡occurred ¡or ¡the ¡‘null’ ¡hypothesis ¡is ¡false.” ¡ However, ¡to ¡offset ¡this ¡weakness, ¡Fisher ¡argues ¡that ¡significance ¡tests ¡may ¡be ¡ performed ¡even ¡when ¡the ¡space ¡of ¡alternative ¡hypotheses ¡is ¡vaguely ¡specified ¡— ¡ unlike ¡the ¡conditions ¡for ¡likelihood ¡or ¡fiducial ¡reasoning. ¡

¡

What ¡makes ¡an ¡outcome ¡“rare”? ¡ ¡One ¡scheme ¡for ¡making ¡sense ¡of ¡Fisher’s ¡idea ¡ (well ¡stated ¡by ¡Cramér ¡[1946]) ¡is ¡to ¡introduce ¡a ¡discrepancy ¡ranking ¡D ¡on ¡the ¡ sample ¡space ¡of ¡possible ¡outcomes ¡Ω. ¡ ¡ ¡D: ¡Ω ¡→ ℜ. ¡ ¡ ¡ ¡ The ¡intended ¡meaning ¡is ¡that ¡outcomes ¡with ¡larger ¡discrepancy ¡are ¡“rarer” ¡under ¡ the ¡null ¡hypothesis. ¡ ¡Then, ¡the ¡significance ¡level ¡attained ¡on ¡a ¡trial ¡is ¡the ¡ probability ¡(given ¡the ¡null ¡hypothesis ¡H) ¡of ¡obtaining ¡a ¡discrepancy ¡at ¡least ¡as ¡ great ¡as ¡that ¡observed. ¡ ¡ ¡

SLIDE 14 ¡ With ¡i.i.d ¡multinomial ¡data, ¡Fisher ¡[SMfRW, ¡§21.02] ¡favored ¡the ¡ ¡

- Exact ¡Test: ¡Discrepancy ¡is ¡inversely ¡related ¡to ¡the ¡probability ¡of ¡cell ¡counts. ¡

Call ¡this ¡the ¡probabilistic ¡discrepancy ¡ranking, ¡Dp. ¡ ¡ ¡ That ¡is, ¡with ¡a ¡simple ¡statistical ¡hypothesis ¡H, ¡and ¡m ¡cell ¡counts, ¡ ¡ aj ¡(j ¡= ¡1, ¡..., ¡m), ¡ ¡∑j ¡aj ¡= ¡N, ¡then ¡(where ¡pj ¡is ¡fixed ¡by ¡H) ¡ ¡Dp<a1, ¡.., ¡am> ¡ ¡= ¡ ¡[ ¡(N! ¡÷ ¡Πj aj!) ¡Πj ¡pjaj ¡]-‑1. ¡ ¡ Asymptotically, ¡for ¡increasing ¡sample ¡size, ¡the ¡probabilistic ¡discrepancy ¡ranking ¡ agrees ¡with ¡the ¡χ2-‑discrepancy ¡ranking ¡(on ¡m-‑1 ¡degrees ¡of ¡freedom), ¡Dχ2; ¡ ¡

- where ¡Dχ2 ¡discrepancy ¡of ¡a ¡data ¡set ¡is ¡according ¡to ¡its ¡χ2 ¡value. ¡ ¡ ¡

¡ With ¡categorical ¡data, ¡χ2 ¡gives ¡a ¡convenient ¡approximation ¡to ¡Fisher’s ¡Exact ¡Test. ¡

SLIDE 15

The ¡controversial ¡aspect ¡of ¡Fisher’s ¡treatment ¡of ¡independence ¡significance ¡tests ¡ in ¡contingency ¡tables ¡stems ¡from ¡his ¡claim ¡that ¡the ¡analysis ¡should ¡take ¡the ¡ marginal ¡totals ¡as ¡given. ¡ ¡ ¡ ¡ Fisher ¡treats ¡the ¡2 ¡× 2 ¡table ¡with ¡the ¡three ¡quantities, ¡N, ¡n1, ¡and ¡a+c ¡ ¡ancillary. ¡ ¡

¡ In ¡the ¡illustration ¡with ¡the ¡two ¡biased ¡coins, ¡it ¡is ¡commonplace ¡to ¡assume ¡that ¡the ¡sample ¡ sizes ¡(n1 ¡and ¡n2, ¡hence ¡also ¡N) ¡are ¡ancillary: ¡they ¡are ¡chosen ¡in ¡the ¡design ¡independent ¡of ¡H. ¡ ¡ ¡ ¡ The ¡assertion ¡that ¡a+c ¡(the ¡total ¡count ¡of ¡heads ¡from ¡the ¡two ¡coins) ¡is ¡uninformative ¡about ¡ the ¡null ¡hypothesis ¡of ¡independence ¡is ¡without ¡foundation. ¡ ¡ ¡ Clearly, ¡it ¡is ¡a ¡false ¡statement ¡for ¡extreme ¡cases, ¡e.g., ¡when ¡a+c ¡= ¡0. ¡ ¡ ¡ ¡

However, ¡if ¡we ¡grant ¡Fisher’s ¡assumption, ¡that ¡the ¡marginal ¡totals ¡give ¡no ¡relevant ¡ information ¡in ¡the ¡test ¡of ¡the ¡null ¡hypothesis ¡that ¡the ¡coins ¡are ¡equally ¡biased, ¡ then ¡the ¡Exact ¡Test ¡assumes ¡a ¡convenient ¡form ¡independent ¡of ¡the ¡value ¡θ0 ¡of ¡the ¡ common ¡bias. ¡ ¡ ¡ ¡ Then, ¡given ¡the ¡four ¡marginal ¡totals, ¡Dp({a,b,c,d}) ¡= ¡[a!b!c!d!]. ¡ ¡ ¡

SLIDE 16

¡

How ¡does ¡Dp ¡compare ¡to ¡Dχ2 ¡for ¡the ¡same ¡null ¡hypothesis? ¡ ¡In ¡particular, ¡what ¡of ¡ Fisher’s ¡use ¡of ¡the ¡m.l.e. ¡in ¡computing ¡the ¡1-‑degree ¡of ¡freedom ¡χ2? ¡

¡

The ¡answer ¡is ¡contained ¡in ¡a ¡decomposition ¡of ¡χ2. ¡ ¡ ¡ ¡ ¡ Recall, ¡ ¡ 𝜓!

!= ¡(a-‑θ0n1)2/θ0n1 ¡+ ¡(b-‑[1-‑θ0]n1)2/[1-‑θ0]n1 ¡+ ¡(c-‑θ0n2)2/θ0n2 ¡+ ¡(d-‑[1-‑θ0]n2)2/[1-‑θ0]n2. ¡

¡

With ¡some ¡simple ¡algebra, ¡ 𝜓!

! ¡= ¡[θ0 ¡-‑ ¡(a+c)/N]2 ¡N÷θ0(1-‑ ¡θ0) ¡ ¡ ¡+ ¡ ¡(n1n2÷N){a/n1 ¡ ¡-‑ ¡c/n2}2÷[θ0(1-‑ ¡θ0)]. ¡ ¡ ¡ ¡[*] ¡

¡

¡ ¡ ¡ ¡ ¡

SLIDE 17

Write ¡the ¡second ¡summand ¡of ¡[*] ¡as ¡ ¡ Q2 ¡ ¡= ¡ ¡(n1n2){a/n1 ¡ ¡-‑ ¡c/n2}2 ¡÷ ¡[Nθ0(1-‑ ¡θ0)]. ¡ This ¡is ¡the ¡negative ¡exponent ¡in ¡the ¡asymptotic ¡(normal) ¡density ¡for ¡the ¡difference ¡ in ¡the ¡two ¡sample ¡averages. ¡ ¡ ¡ Asymptotically, ¡a/n1 ¡and ¡c/n2 ¡are ¡independently ¡a ¡bivariate ¡normal ¡pair ¡ ¡ with ¡a/n1 ¡normal ¡N(θ0, ¡θ0(1-‑ ¡θ0)÷n1), ¡and ¡c/n2 ¡normal ¡N(θ0, ¡θ0(1-‑ ¡θ0)÷n2). ¡ ¡ ¡ ¡ Hence, ¡the ¡quantity ¡(a/n1 ¡-‑ ¡c/n2) ¡is ¡normally ¡distributed ¡N(0, ¡θ0(1-‑ ¡θ0)N÷n1n2). ¡ ¡ ¡ ¡ Thus, ¡ ¡ ¡ Q2 ¡ ¡= ¡ ¡(n1n2){a/n1 ¡ ¡-‑ ¡c/n2}2 ¡÷ ¡[Nθ0(1-‑ ¡θ0)] ¡ ¡ ¡ ¡ is ¡ ¡nothing ¡other ¡than ¡the ¡Fisher’s ¡Probabilistic ¡Discrepancy ¡Dp ¡for ¡a ¡significance ¡ test ¡of ¡the ¡hypothesis ¡that ¡the ¡coins ¡are ¡equally ¡biased, ¡using ¡the ¡ ¡ difference ¡in ¡sample ¡averages ¡as ¡the ¡test ¡statistic. ¡ ¡ ¡

SLIDE 18

By ¡Fisher’s ¡assumption ¡that ¡the ¡marginal ¡totals ¡are ¡irrelevant, ¡this ¡statistic, ¡the ¡ sample ¡difference ¡in ¡means, ¡exhausts ¡the ¡data: ¡it ¡is ¡sufficient ¡given ¡“ancillary” ¡data. ¡ ¡ The ¡nuisance ¡parameter ¡(θ0) ¡appears ¡in ¡ ¡ Q2 ¡ ¡= ¡ ¡(n1n2){a/n1 ¡ ¡-‑ ¡c/n2}2 ¡÷ ¡[Nθ0(1-‑ ¡θ0)]. ¡ as ¡part ¡of ¡the ¡variance ¡term; ¡however, ¡it ¡may ¡be ¡removed ¡by ¡Studentizing ¡the ¡ unknown ¡Normal ¡variance. ¡ ¡ ¡ ¡ Here ¡is ¡where ¡the ¡choice ¡of ¡estimate ¡for ¡θ0 ¡plays ¡a ¡role ¡in ¡the ¡decomposition ¡of ¡χ2. ¡ ¡ ¡ ¡ The ¡left ¡hand ¡summand ¡in ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡𝜓!

! ¡= ¡[θ0 ¡-‑ ¡(a+c)/N]2 ¡N÷θ0(1-‑ ¡θ0) ¡ ¡ ¡+ ¡ ¡(n1n2÷N){a/n1 ¡ ¡-‑ ¡c/n2}2÷[θ0(1-‑ ¡θ0)]. ¡ ¡ ¡ ¡[*] ¡ ¡

is ¡recognized ¡as [θ0 ¡-‑ ¡(a+c)/N]2 ¡Iθ0[N] ¡, ¡where ¡Iθ0[N] ¡denotes ¡the ¡Fisher-‑Information ¡ about ¡a ¡binomial ¡parameter ¡contained ¡in ¡a ¡sample ¡of ¡size ¡N. ¡ ¡Upon ¡adopting ¡an ¡ estimate ¡T(data) ¡= ¡T ¡for ¡θ0, ¡we ¡see ¡that ¡the ¡left ¡hand ¡summand ¡in ¡[*] ¡becomes: ¡ ¡

SLIDE 19 [T ¡-‑ ¡(a+c)/N]2 ¡N ¡÷ ¡T(1-‑Τ). ¡ This ¡term ¡is ¡positive ¡for ¡all ¡estimates, ¡except ¡when ¡T ¡is ¡the ¡m.l.e ¡for ¡θ0, ¡that ¡is, ¡ except ¡when ¡ ¡ ¡ T ¡= ¡(a+c)÷N. ¡ ¡ ¡

Aside: ¡ ¡This ¡decomposition ¡[*] ¡of ¡χ2 ¡provides ¡a ¡2nd ¡order ¡criterion ¡among ¡ ¡ ¡ ¡ ¡ ¡ ¡(1st ¡order) ¡F-‑efficient ¡estimators. ¡ ¡ ¡

¡ In ¡short, ¡the ¡left ¡hand ¡term, ¡[Τ ¡-‑ ¡(a+c)/N]2 ¡N ¡÷ ¡Τ(1-‑Τ), ¡indicates ¡the ¡excess ¡ ¡ discrepancy ¡in ¡χ2 ¡that ¡results ¡from ¡using ¡an ¡estimator ¡other ¡than ¡the ¡m.l.e. ¡ ¡ ¡ Thus, ¡in ¡a ¡Fisherian ¡Goodness-‑of-‑Fit ¡test, ¡relative ¡to ¡the ¡null ¡hypothesis, ¡conclude: ¡

- The ¡“rarity” ¡assigned ¡the ¡data ¡reflects ¡the ¡informativeness ¡of ¡the ¡test ¡statistic ¡

(used ¡to ¡approximate ¡the ¡Exact ¡Test). ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡Avoid ¡inflating ¡the ¡“rarity” ¡by ¡using ¡less ¡than ¡a ¡maximally ¡informative ¡statistic. ¡ ¡

SLIDE 20 Thus, ¡to ¡have ¡Dχ2 ¡ ¡agree ¡with ¡the ¡discrepancy ¡from ¡the ¡Exact ¡Test, ¡Dp, ¡ ¡

- You ¡must ¡use ¡the ¡m.l.e. ¡for ¡θ0 ¡! ¡

¡ Though ¡total ¡χ2 ¡is ¡reduced ¡by ¡using ¡the ¡minimum ¡χ2 ¡estimate, ¡compared ¡with ¡ using ¡the ¡m.l.e. ¡for ¡θ0 ¡in ¡χ2, ¡the ¡minimum ¡χ2 ¡estimate ¡yields ¡a ¡test ¡of ¡significance ¡ with ¡inflated ¡discrepancy ¡in ¡comparison ¡with ¡the ¡Fisher ¡Exact ¡(asymptotic) ¡test. ¡ ¡ ¡ ¡ Thus, ¡we ¡have ¡a ¡reconstruction ¡of ¡one ¡of ¡Fisher’s ¡(neglected) ¡arguments ¡for ¡the ¡ supremacy ¡of ¡maximum ¡likelihood ¡estimation, ¡based ¡on ¡the ¡role ¡F-‑Information ¡ plays ¡in ¡a ¡Goodness-‑of-‑Fit ¡significance ¡test. ¡[See ¡his ¡S.M.f.R.W. ¡14th ¡ed. ¡§57.] ¡

- Let ¡“rarity” ¡reflect ¡the ¡informativeness ¡of ¡the ¡data, ¡as ¡illustrated ¡above. ¡ ¡ ¡

- Do ¡not ¡inflate ¡“rarity” ¡by ¡using ¡a ¡Discrepancy ¡ranking ¡that ¡(misleading) ¡

increases ¡discrepancy ¡beyond ¡the ¡F-‑Information ¡in ¡the ¡data. ¡

SLIDE 21

Charles Sanders Peirce (1839 – 1914) Peirce (1878) identified a step in scientific inference that he called Abduction. Informal account of Abduction Surprising fact F has been observed. If testable Hypothesis H were true, F would be explained/predicted and F would no longer being surprising. Therefore, testable Hypothesis H is worthy of testing though controlled experimental data.

Aside: For Peirce, belief is relief from doubt. Both are real psychological states that have well defined behavior consequences.

SLIDE 22

Let us put thesed two ideas together: 1) Use F-Information as a device for signaling to a Subjectivist that she has reasonable grounds to question her statistical model. 2) Use F-Information for abduction – to form test-worthy statistical models. Continuing Example: A swarm of Subjectivists agree on an i.i.d. Bernoulli model for binary data. Each one has an Exchangeable probability about the denumerable sequence. But then they see: < 1,0,1,0,1,0,1,0,1,0,1,0,1,0,1,0,1,0,1,0 > with s20 = 10. Their “model” does not pass the “Interocular Traumatic Test”!

(See Edwards, Lindman, and Savage, 1963, p. 235.)

SLIDE 23

- How to create a “Goodness of Fit” test for the Subjectivists’ shared model

that does not depend upon their individual “marginal” priors for the parameter? Note that the shared judgment of Exchangeability entails a shared judgment about F-Information: The pair (sn, n) is sufficient (about θ) for the full data. P(data | (sn, n), θ) ¡= ¡P(data | (sn, n)) = Uniform over the

𝒐 𝒕𝒐 - many permutations.

The “model” entails this parameter-independent conditional probability. Then, the “model” also entails a parameter-independent conditional distribution of F-Information in a division of the sample into two sets: (sn1, sn2).

SLIDE 24

Conditioned by the sufficient statistic, the conditional distribution for sn1 follows the hyper-geometric distribution for getting: sn1 successes out of n1 draws without replacement from a population of size n containing sn successes. P(sn1 , n1 , n, sn) =

𝒕𝒐 𝒕𝒐𝟐 𝒐!𝒕𝒐 𝒐𝟐!𝒕𝒐𝟐 𝒐 𝒐𝟐

¡ Aside: ¡ ¡Take ¡good ¡note ¡of ¡the ¡relations ¡with ¡finite-‑exchangeability! ¡ ¡ The ¡(expected) ¡F-‑information ¡in ¡this ¡draw ¡is ¡the ¡inverse ¡of ¡its ¡variance: ¡ Var(sn1 , n1 , n, sn) = n1

𝒕𝒐 𝒐 𝒐 ¡! ¡𝒕𝒐 𝒐 𝒐!𝒐𝟐 𝒐!𝟐 ¡

¡ We ¡can ¡create ¡an ¡F-‑information ¡discrepancy ¡ranking ¡DFI ¡associated ¡with ¡ the ¡departure ¡in ¡the ¡subsample ¡from ¡this ¡expected ¡value. ¡

SLIDE 25

¡ Evidently, ¡with ¡the ¡partition ¡of ¡the ¡observed ¡sample ¡into ¡the ¡odd ¡and ¡even ¡ numbered ¡observations, ¡the ¡DFI ¡discrepancy ¡achieves ¡it ¡maximum. ¡ ¡ < 1,0,1,0,1,0,1,0,1,0,1,0,1,0,1,0,1,0,1,0 > with s20 = 10. So our swarm of Subjectivists have a consensus that the observed data are indeed rare (or surprising) as measured by how much F-Information there is about the “model’s” parameter, as contained in the (two) subsample(s). Then they can ask (and answer) Peirce’s abductive question: Q: What kind of “model” will relieve us of this surprise? A: Consider a “model” based on partial exhangeability!

SLIDE 26

Summary ¡and ¡Next ¡Steps ¡

1) We ¡reviewed ¡how ¡exchangeability ¡and ¡partial ¡exchangeability ¡may ¡be ¡used ¡ (via ¡de ¡Finetti’s ¡theorems) ¡to ¡identify ¡what ¡it ¡means ¡for ¡a ¡Subjectivist ¡to ¡ have ¡a ¡statistical ¡model, ¡and ¡how ¡there ¡can ¡be ¡shared ¡agreements ¡across ¡ Subjectivists ¡about ¡a ¡statistical ¡model. ¡ 2) We ¡asked ¡how ¡a ¡Subjectivist ¡might ¡use ¡the ¡data ¡to ¡update ¡her ¡model ¡by ¡ Bayesian ¡conditioning. ¡– ¡But ¡this ¡approach ¡runs ¡into ¡Cromwell’s ¡Rule. ¡ 3) We ¡reviewed ¡how ¡F-‑Information ¡plays ¡a ¡role ¡in ¡Fisher’s ¡construction ¡of ¡the ¡ Dχ2 ¡ranking, ¡as ¡a ¡substitute ¡for ¡Fisher’s ¡Exact ¡Test, ¡when ¡there ¡is ¡a ¡nuisance ¡ parameter ¡that ¡needs ¡to ¡be ¡estimated. ¡ 4) We ¡combined ¡two ¡related ¡ideas ¡– ¡from ¡ ¡ ¡ ¡ ¡ Fisher ¡– ¡Goodness-‑of-‑Fit ¡for ¡raising ¡doubts ¡about ¡a ¡model ¡ ¡ ¡ ¡ ¡ ¡and ¡ ¡ ¡ ¡ ¡ ¡ ¡ Peirce ¡– ¡abduction ¡to ¡new ¡models ¡that ¡may ¡relieve ¡doubt ¡about ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡the ¡data ¡that ¡cause ¡doubts ¡about ¡the ¡first ¡model. ¡ 5) I ¡sketched ¡how ¡a ¡Subjectivist ¡might ¡apply ¡the ¡ideas ¡in ¡4) ¡by ¡using ¡ ¡ ¡ ¡ ¡ ¡F-‑Information ¡both ¡as ¡ ¡ the ¡basis ¡for ¡a ¡Discrepancy ¡ranking ¡ ¡ ¡ ¡ ¡ ¡ ¡and ¡as ¡ ¡ the ¡utility ¡to ¡be ¡gained ¡when ¡relieving ¡doubt ¡via ¡abduction. ¡ ¡

SLIDE 27 There ¡is ¡much ¡work ¡yet ¡to ¡do ¡in ¡order ¡to ¡make ¡this ¡idea ¡work. ¡ Open ¡ ¡Q1: ¡ ¡ ¡ How ¡to ¡use ¡F-‑Information ¡to ¡modulate ¡the ¡complexity ¡of ¡the ¡allowed ¡ ¡ partitions ¡of ¡ ¡the ¡data ¡that ¡may ¡be ¡used ¡with ¡the ¡DFI ¡discrepancy ¡ranking. ¡ The ¡threat ¡is ¡overfitting ¡with ¡models ¡of ¡arbitrary ¡complexity ¡that, ¡ ¡ nonetheless, ¡show ¡increased ¡F-‑Information ¡over ¡the ¡original ¡model. ¡ One ¡binary ¡partition ¡into ¡2 ¡sets ¡of ¡size ¡10 ¡from ¡the ¡s20 = 10 data set

yields two homogeneous sub-samples, s1 = 10, s2 = 0. ¡ ¡ ¡ ¡ ¡

¡

Diaconis ¡and ¡Freedman ¡(1982) ¡review ¡how ¡to ¡reverse ¡engineer ¡a ¡statistical ¡model ¡ from ¡an ¡assumption ¡that ¡a ¡particular ¡set ¡of ¡statistics ¡are ¡sufficient ¡for ¡the ¡parameters ¡

- f ¡that ¡model. ¡ ¡Use ¡the ¡parameter ¡independent ¡distribution ¡of ¡the ¡full ¡data ¡given ¡the ¡

sufficient ¡statistics ¡to ¡characterize ¡an ¡equivalent ¡condition ¡of ¡partial ¡exchangeability. ¡

- Can ¡these ¡results ¡be ¡used ¡to ¡address ¡Open ¡Q1? ¡

¡ Open ¡Q2: ¡ ¡ ¡ ¡ Which ¡other ¡Information-‑divergences ¡make ¡for ¡a ¡sensible ¡ ¡ ¡ ¡ discrepancy ¡ranking, ¡when ¡that ¡ranking ¡is ¡used ¡as ¡proposed ¡here? ¡ ¡

SLIDE 28

References ¡

Bruno, ¡A. ¡(1964) ¡On ¡the ¡Notion ¡of ¡Partial ¡Exchangeability. ¡J. ¡Italian ¡Inst. ¡of ¡ ¡Actuarial ¡ ¡ Science ¡27. ¡Translated ¡by ¡G.Majone; ¡chpt. ¡10 ¡in ¡de ¡Finetti ¡(1972). ¡ Cramér, ¡H. ¡(1946) ¡Mathematical ¡Methods ¡of ¡Statistics. ¡Princeton: ¡Princeton ¡U. ¡Press. ¡ Diaconis, ¡P. ¡(1988) ¡Recent ¡Progress ¡on ¡de ¡Finetti’s ¡Notions ¡of ¡Exchangeability. ¡ ¡In ¡J.M. ¡ ¡ Bernardo, ¡M.H.DeGroot, ¡D.V.Lindley, ¡and ¡A.F.M.Smith ¡(Eds.) ¡Bayesian ¡Statistics ¡3, ¡ ¡ pp ¡111-‑125. ¡ ¡Oxford: ¡Oxford ¡U. ¡Press. ¡ Diaconis, ¡P. ¡and ¡Freedman, ¡D. ¡(1982) ¡Partial ¡Exchangeability ¡and ¡Sufficiency. ¡Tech. ¡ ¡ Report ¡190. ¡ ¡Dept. ¡of ¡Statistics, ¡Stanford ¡University. ¡ Edwards, ¡W., ¡Lindman, ¡H. ¡and ¡Savage, ¡L.J. ¡(1963) ¡Bayesian ¡statistical ¡inference ¡for ¡ ¡ psychological ¡research ¡Psychological ¡Review, ¡70(3): ¡193-‑242. ¡ de ¡Finetti, ¡B. ¡(1959) ¡Probability, ¡Statistics, ¡and ¡Induction. ¡CIME. ¡ ¡Translated ¡by ¡ ¡I. ¡Cesari ¡ ¡ and ¡L.J.Savage; ¡chpt. ¡9 ¡in ¡de ¡Finetti ¡(1972). ¡ De ¡Finetti, ¡B. ¡(1972) ¡Probability, ¡Induction, ¡and ¡Statistics: ¡The ¡art ¡of ¡guessing. ¡ ¡London: ¡ ¡ John ¡Wiley. ¡ Fisher, ¡R.A. ¡(1925) ¡Statistical ¡Methods ¡for ¡Research ¡Workers ¡(14th ¡ed., ¡1973) ¡New ¡ ¡ York: ¡Hafner ¡Press. ¡ Peirce, ¡C. ¡S. ¡(1878) ¡Deduction, ¡Induction, ¡and ¡Hypothesis ¡Popular ¡Science ¡Monthly, ¡13: ¡ ¡ 470–82, ¡In ¡ ¡Peirce’s ¡Collected ¡Papers ¡2.619–44. ¡