1

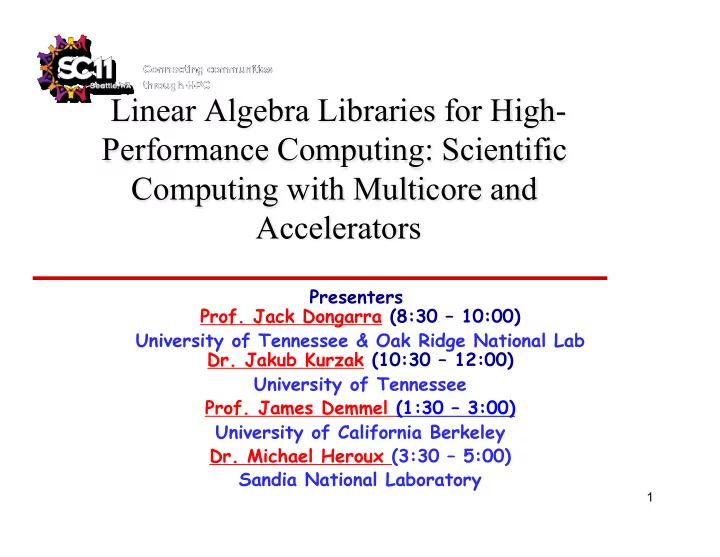

Linear Algebra Libraries for High- Performance Computing: Scientific Computing with Multicore and Accelerators

Presenters

- Prof. Jack Dongarra (8:30 – 10:00)

University of Tennessee & Oak Ridge National Lab

- Dr. Jakub Kurzak (10:30 – 12:00)

University of Tennessee

- Prof. James Demmel (1:30 – 3:00)

University of California Berkeley

- Dr. Michael Heroux (3:30 – 5:00)

Sandia National Laboratory