DUNE 35-ton Prototype Offline News and Announcements Tom - PowerPoint PPT Presentation

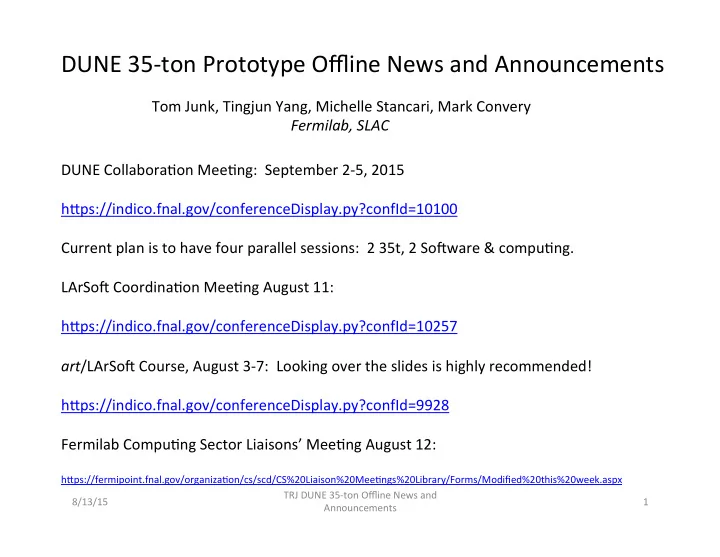

DUNE 35-ton Prototype Offline News and Announcements Tom Junk, Tingjun Yang, Michelle Stancari, Mark Convery Fermilab, SLAC DUNE CollaboraNon MeeNng:

DUNE ¡35-‑ton ¡Prototype ¡Offline ¡News ¡and ¡Announcements ¡ Tom ¡Junk, ¡Tingjun ¡Yang, ¡Michelle ¡Stancari, ¡Mark ¡Convery ¡ Fermilab, ¡SLAC ¡ DUNE ¡CollaboraNon ¡MeeNng: ¡ ¡September ¡2-‑5, ¡2015 ¡ ¡ hRps://indico.fnal.gov/conferenceDisplay.py?confId=10100 ¡ ¡ Current ¡plan ¡is ¡to ¡have ¡four ¡parallel ¡sessions: ¡ ¡2 ¡35t, ¡2 ¡SoXware ¡& ¡compuNng. ¡ ¡ LArSoX ¡CoordinaNon ¡MeeNng ¡August ¡11: ¡ ¡ hRps://indico.fnal.gov/conferenceDisplay.py?confId=10257 ¡ ¡ art /LArSoX ¡Course, ¡August ¡3-‑7: ¡ ¡Looking ¡over ¡the ¡slides ¡is ¡highly ¡recommended! ¡ ¡ hRps://indico.fnal.gov/conferenceDisplay.py?confId=9928 ¡ ¡ Fermilab ¡CompuNng ¡Sector ¡Liaisons’ ¡MeeNng ¡August ¡12: ¡ ¡ hRps://fermipoint.fnal.gov/organizaNon/cs/scd/CS%20Liaison%20MeeNngs%20Library/Forms/Modified%20this%20week.aspx ¡ ¡ TRJ ¡DUNE ¡35-‑ton ¡Offline ¡News ¡and ¡ 8/13/15 ¡ 1 ¡ Announcements ¡

TRJ ¡DUNE ¡35-‑ton ¡Offline ¡News ¡and ¡ 8/13/15 ¡ 2 ¡ Announcements ¡

TRJ ¡DUNE ¡35-‑ton ¡Offline ¡News ¡and ¡ 8/13/15 ¡ 3 ¡ Announcements ¡

35-‑ton ¡CompuNng ¡TSW ¡(Technical ¡Scope ¡of ¡Work) ¡ Delineates ¡compuNng ¡services ¡and ¡support ¡35-‑ton ¡needs ¡in ¡order ¡to ¡ ¡ commission, ¡operate, ¡and ¡analyze ¡the ¡collected ¡data. ¡ ¡ Already ¡reviewed ¡twice ¡by ¡the ¡35-‑ton ¡group. ¡ TSW ¡Link ¡on ¡SharePoint ¡ Sent ¡to ¡the ¡CompuNng ¡Sector ¡for ¡review ¡Nll ¡the ¡end ¡of ¡August ¡ ¡ and ¡send ¡out ¡for ¡signatures ¡on ¡September ¡1. ¡ ¡ ¡ CompuNng ¡Sector ¡people ¡for ¡review: ¡ ¡ Ray ¡Pasetes, ¡Mitch ¡Renfer, ¡Rob ¡Harris, ¡Adam ¡Lyon, ¡Stu ¡Fuess, ¡Margaret ¡Votava ¡ ¡ TRJ ¡DUNE ¡35-‑ton ¡Offline ¡News ¡and ¡ 8/13/15 ¡ 4 ¡ Announcements ¡

DUNE ¡CompuNng ¡Resources ¡ • New ¡DUNE ¡service ¡desk ¡pull-‑down ¡menu ¡category: ¡ ¡E-‑1062. ¡ ¡ ¡ ¡ ¡ ¡ ¡ ¡Gelng ¡more ¡funcNonal! ¡ ¡Now ¡has ¡sub-‑categories ¡ ¡ • DUNE ¡VO ¡has ¡been ¡created ¡– ¡Steve ¡Timm ¡and ¡Tom ¡Junk ¡are ¡admins, ¡ ¡ ¡ ¡Steve ¡Timm ¡is ¡the ¡security ¡contact. ¡ ¡ • SNll ¡some ¡work ¡to ¡get ¡the ¡VO ¡accepted ¡by ¡grid ¡worker ¡sites. ¡ • LBNE ¡VO ¡users ¡should ¡be ¡grandfathered ¡in ¡(though ¡may ¡are ¡suspended ¡due ¡to ¡ ¡ ¡ ¡ ¡expired ¡Acceptable ¡Use ¡Policy ¡forms) ¡ ¡ • New ¡DUNE ¡VO ¡membership ¡to ¡be ¡granted ¡along ¡with ¡DUNE ¡interacNve ¡accounts. ¡ Other ¡DUNE ¡resources: ¡TO ¡DO ¡ dunegpvm01.fnal.gov ¡through ¡dunegpvm10.fnal.gov: ¡ Service ¡desk ¡Ncket ¡submiRed. ¡ ¡“Tail ¡end ¡of ¡a ¡long ¡process”. ¡ ¡MeeNng ¡to ¡kick ¡off ¡ general ¡DUNE ¡renaming/new ¡instance ¡creaNon ¡July ¡29, ¡organized ¡by ¡Q. ¡Li. ¡ ¡ DUNE ¡BlueArc ¡areas ¡– ¡to ¡do ¡ TRJ ¡DUNE ¡35-‑ton ¡Offline ¡News ¡and ¡ 8/13/15 ¡ 5 ¡ Announcements ¡

DUNE ¡CompuNng ¡Resources ¡ /grid/fermiapp/products/dune ¡ ¡ Area ¡requested ¡in ¡a ¡Service ¡Desk ¡Ncket. ¡ ¡M. ¡Kirby ¡had ¡helped ¡us ¡set ¡up ¡the ¡ /grid/fermiapp/products/lbne ¡ ¡ area. ¡ ¡ /pnfs/dune/scratch ¡– ¡not ¡there ¡yet ¡ /pnfs/dune/persistent ¡ ¡-‑-‑ ¡this ¡exists ¡and ¡shares ¡space ¡with ¡/pnfs/lbne/persistent ¡ ¡ DUNE ¡redmine ¡area ¡– ¡already ¡there! ¡ ¡ dunetpc ¡redmine/repo ¡– ¡working ¡on ¡it! ¡ ¡See ¡Tingjun’s ¡talk ¡on ¡Aug ¡11. ¡ ¡ Renaming ¡all ¡files ¡and ¡changing ¡lbne ¡in ¡the ¡contents ¡of ¡files, ¡all ¡the ¡while ¡retaining ¡ git ¡history ¡(using ¡git ¡mv). ¡ ¡daqinput35t ¡and ¡roouiles ¡are ¡kept ¡with ¡lbne ¡in ¡their ¡names ¡ in ¡order ¡not ¡to ¡disrupt ¡ongoing ¡daq ¡work. ¡ TRJ ¡DUNE ¡35-‑ton ¡Offline ¡News ¡and ¡ 8/13/15 ¡ 6 ¡ Announcements ¡

DAQ ¡Data ¡Transfer ¡Status ¡ All ¡complete ¡VST ¡roouiles ¡through ¡the ¡end ¡of ¡July ¡2015 ¡transferred ¡from ¡ /data/lbnedaq/data ¡on ¡lbne35t-‑gateway01 ¡to ¡offline ¡storage ¡(SAM). ¡ ¡ hRps://cdcvs.fnal.gov/redmine/projects/35ton/wiki/LBNE35tVerNcalSliceTestDataFiles ¡ ¡ Files ¡from ¡May ¡2015 ¡onwards ¡are ¡sNll ¡on ¡the ¡gateway01 ¡node ¡– ¡can ¡be ¡deleted. ¡ ¡ Data ¡disk ¡on ¡the ¡gateway ¡node ¡is ¡93% ¡full ¡– ¡sNll ¡has ¡17 ¡GB ¡leX. ¡ ¡ Script ¡for ¡copying ¡data ¡from ¡the ¡gateway ¡node ¡to ¡lbnegpvm* ¡with ¡a ¡target ¡ directory ¡on ¡dCache ¡wriRen ¡and ¡tested. ¡ ¡ New ¡lbnedaq ¡shared ¡account ¡created ¡on ¡the ¡lbnegpvm’s. ¡ ¡So ¡far ¡I ¡cannot ¡log ¡on ¡to ¡it ¡ however, ¡and ¡submiRed ¡a ¡Service ¡Desk ¡Ncket. ¡ ¡This ¡is ¡so ¡we ¡don’t ¡have ¡to ¡use ¡Mike ¡ ¡ Wallbank’s ¡Kerberos ¡Ncket ¡to ¡transfer ¡DQM ¡plots. ¡ ¡But ¡also ¡useful ¡for ¡data, ¡but ¡... ¡ ¡ But ¡Ed ¡Simmonds ¡(SCD) ¡does ¡not ¡recommend ¡using ¡the ¡gpvm’s ¡as ¡part ¡of ¡the ¡DAQ ¡ chain. ¡ ¡Not ¡24x7 ¡resilient. ¡ ¡To ¡minimize ¡“hops”, ¡we’d ¡like ¡to ¡mount ¡BlueArc ¡ /lbne/data, ¡/lbne/data2 ¡and ¡dCache ¡/pnfs/lbne/scratch ¡on ¡lbnegateway02.fnal.gov ¡ TRJ ¡DUNE ¡35-‑ton ¡Offline ¡News ¡and ¡ 8/13/15 ¡ 7 ¡ Announcements ¡

dCache ¡News, ¡Advice ¡ Scratch ¡space: ¡ ¡/pnfs/lbne/scratch ¡ ¡-‑-‑ ¡very ¡large, ¡but ¡there ¡is ¡a ¡Least ¡Recently ¡Used ¡ evicNon ¡algorithm. ¡ ¡ ¡ ¡File ¡lifeNme ¡is ¡of ¡order ¡1 ¡month. ¡ ¡NOvA ¡writes ¡to ¡scratch ¡very ¡ frequently. ¡ ¡ ¡ Persistent ¡space: ¡/pnfs/lbne/persistent ¡ ¡ ¡ ¡/pnfs/dune/persistent ¡ Size: ¡ ¡150 ¡TB ¡ ¡ ¡(shared ¡between ¡lbne ¡and ¡dune ¡areas) ¡ ¡ ¡Hardware ¡failure ¡may ¡result ¡in ¡file ¡loss ¡– ¡this ¡area ¡is ¡not ¡backed ¡up. ¡ ¡See ¡Qizhong’s ¡ ¡ ¡descripNon ¡of ¡how ¡to ¡store ¡files ¡on ¡tape. ¡ ¡ No ¡quotas ¡(yet). ¡ ¡ dCache ¡is ¡meant ¡to ¡be ¡used ¡for ¡data ¡that ¡may ¡also ¡be ¡on ¡tape. ¡ ¡ ¡Most ¡suited ¡to ¡ write ¡once, ¡read-‑many ¡access ¡paRerns. ¡ ¡ Several ¡consequences ¡of ¡the ¡dCache ¡architecture ¡ ¡(from ¡R. ¡Illingworth) ¡ Files ¡are ¡immutable ¡(cannot ¡be ¡modified) ¡once ¡wriRen ¡ Latency ¡is ¡usually ¡low ¡for ¡files ¡on ¡disk, ¡but ¡very ¡high ¡for ¡files ¡retrieved ¡from ¡tape ¡ Under ¡heavy ¡load ¡accesses ¡are ¡queued ¡by ¡file ¡ Uncoordinated ¡or ¡random ¡access ¡of ¡files ¡that ¡are ¡not ¡in ¡cache ¡ ¡ can ¡perform ¡very ¡badly, ¡creaNng ¡large ¡backlogs ¡ TRJ ¡DUNE ¡35-‑ton ¡Offline ¡News ¡and ¡ 8/13/15 ¡ 8 ¡ Announcements ¡

Recommend

More recommend

Explore More Topics

Stay informed with curated content and fresh updates.