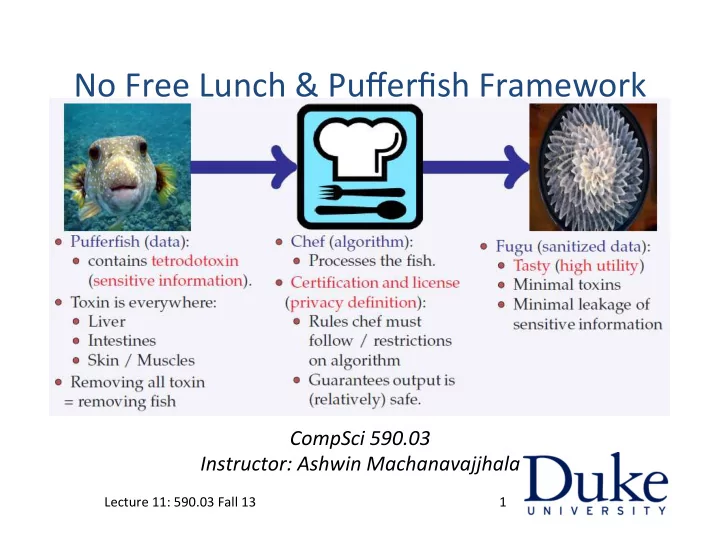

No ¡Free ¡Lunch ¡& ¡Pufferfish ¡Framework ¡

CompSci ¡590.03 ¡ Instructor: ¡Ashwin ¡Machanavajjhala ¡

1 ¡ Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

Outline Recap DifferenCal privacy ensures adversary cant - - PowerPoint PPT Presentation

No Free Lunch & Pufferfish Framework CompSci 590.03 Instructor: Ashwin Machanavajjhala Lecture 11: 590.03 Fall 13 1 Outline Recap DifferenCal

1 ¡ Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 2 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 3 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 4 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 5 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 6 ¡

– Presence ¡or ¡absence ¡of ¡a ¡tuple ¡D, ¡D ¡U ¡{t} ¡ – Change ¡in ¡a ¡tuple ¡D ¡U ¡{x}, ¡D ¡U ¡{y} ¡

– Presence ¡or ¡absence ¡of ¡an ¡edge ¡ ¡ – Presence ¡or ¡absence ¡of ¡a ¡vertex ¡(and ¡all ¡its ¡edges) ¡ ¡

– Presence ¡or ¡absence ¡of ¡one ¡value ¡ – Presence ¡or ¡absence ¡of ¡enCre ¡set ¡

– Change ¡in ¡one ¡Events ¡ – Change ¡in ¡K ¡consecuCve ¡events ¡ – EnCre ¡sequence ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 7 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 8 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 9 ¡

10 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

11 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

12 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

13 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

14 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

15 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

16 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

17 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 18 ¡

19 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

20 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

21 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 22 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 23 ¡

24 ¡

[Kifer-‑Machanavajjhala ¡SIGMOD ¡‘11]

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

[Dwork-‑Naor ¡ ¡JPC ¡‘10]

25 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

26 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

27 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

28 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

29 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 30 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 31 ¡

[Kifer-‑M ¡PODS ¡12] ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 32 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 33 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 34 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 35 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 36 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 37 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 38 ¡

x: ¡record ¡i ¡takes ¡the ¡value ¡x ¡ ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 39 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 40 ¡

!(! !) !!∈!

!

– ¡si

x: ¡record ¡i ¡takes ¡the ¡value ¡x ¡ ¡

– ¡ ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 41 ¡

!(! !) !!∈!

!

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 42 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 43 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 44 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 45 ¡

[Kifer-‑M ¡SIGMOD’11] ¡

[Kifer-‑M ¡PODS’12] ¡

PODS ¡2012 ¡

Lecture ¡11: ¡590.03 ¡Fall ¡13 ¡ 46 ¡